COPU会议纪要丨2024.12.03

12月3日陆主席主持召开COPU例会。

本次会议讨论国内发展通用算力之路,路在何处?

为了便于讨论,会上发表两篇文章如下:

(一)中国计算技术研究所研究员张云泉《建设“主权级大模型”的“中国根”》

“中国高性能计算机TOP100排行榜已经发布了20多年,行业一直通过排行榜观察算力产业的发展趋势和算力服务的性能指标。”在日前举行的第六届中国超级算力大会暨中国智能计算产业联盟理事会上,全国政协委员、中国科学院计算技术研究所研究员张云泉针对《2024年中国高性能计算机TOP100排行榜发布及趋势分析》榜单进行解读时指出,“针对大模型创新涌现和落地应用继续发布2024中国高性能计算机TOP100排行榜。从今年的排行榜看出性能仍呈指数增长,前十名全部超过了10PFLOPS(1万万亿次浮点指令/秒),可以看到算力服务业继续在高歌猛进,达到了71%的水准。”

“近来美国在大模型领域持续发力,Meta公司拟采购35万片英伟达GPU发展自己的大模型,软银集团正尝试投入1000亿美元研发自己的AI芯片,OpenAI更是计划筹集7万亿美元研制生产新AI芯片。”张云泉认为,紧跟着英伟达提出“主权AI”的概念,并将其定义为“一个国家利用自己的基础设施、数据、劳动力和商业网络生产AI的能力”。英伟达官网发布的一篇文章认为,“主权AI”涵盖物理和数据基础设施,后者包括主权级基础大模型,由当地团队开发,并在当地数据集上进行训练,以促进对特定语言、文化和习俗的包容性。

张云泉认为,“主权级大模型”是一个动态概念,它应该是某一时期内最高水平的大模型。这一大模型算力要求最高、智能水平最高,是一个国家AI水平的最高点、基础大模型的基础,也可以被形容为“根模型”。

“主权级大模型”将深刻影响一个国家的科技竞争力,涉及军事、经济、政治等多方面能力。没有“主权级大模型”,就像是国家没有了国防重器,国家就会被打压,国家安全也会受到威胁,必须尽快研制处于国际领先水平的“主权级大模型”,以维护未来的国家安全。

张云泉建议,在国产AI芯片研发制造仍需时日的情况下,要利用我国在超算研发建设中的丰富积累,设立能够支持“主权级”多模态大模型训练的专用超算攻关专项,快速缓解国产“主权级大模型”训练的算力瓶颈,尽快让大模型这样的“清单”成为保卫我们的基石。

“目前大模型使用的GPU最早就是来自超算界。但它在超算上的使用效率不高,却在深度学习和大模型找到了最佳应用点。此外,大模型训练用到的很多技术,例如大规模并行技术、高速网络技术、可靠性技术、绿色功耗技术、液冷技术等,中国超算科研人员都已有很成熟的积累,并且有较高水平。张云泉告诉记者,过去的15年,我国超算的研制水平已经达到世界领先水平,形成了神威、天河和曙光三大世界级超算研制团队,夺得了11次世界冠军和两次超算应用最高奖戈登贝尔奖。我国支撑大模型的“导弹”技术和人才积累相当丰富。通过该专项计划的支持,可以充分利用超算领域多年积累的人才和技术优势,快速形成突破,尽快缩小我国在“主权级大模型”训练领域与美国的差距,为研制更先进适用的大模型专用训练芯片和系统赢得时间。

“多路并进、集中力量解决算力瓶颈。集中全国AI芯片研制力量,组建统一研发团队,优中选优,尽快研制出能够对标英伟达高端训练GPU的大模型训练专用国产芯片,软件和系统。”张云泉建议,在解决AI芯片“卡脖子”的基础性问题上,集中全国AI芯片研制力量,组建由业内权威专家和各主要AI芯片厂家参加的智能算力发展专项组,通过多轮竞争,确定最优的训练芯片研发技术路线和国家标准,择优集中投入资金和优秀人才资源,整合芯片产能,尽快研制出能够满足国产“主权级大模型”训练的十万卡、百万卡甚至千万卡并行算力需求的AI芯片和系统。

目前,国内一些企业往往倾向于使用国外的开源大模型,还经常出现低水平的重复与“内卷”,百模大战使得算力资源过于分散。不利于“主权级大模型”的研发。针对这种现象,张云泉认为,要充分发挥“集中力量办大事”的优势,统一协调国内优质科研产业资源,以取得快速突破,如“两弹一星”工程一样,在智能领域的“核武器”时代占领先机。

“要大力发展经济实用大模型推理产业链。在大模型推理产业链上,通过投资引导低功耗推理芯片和算子库技术攻关,鼓励大模型压缩、适配和性能调优等技术研发,通过规模效应实现成本共担,降低模型推理算力成本,形成经济适用国产大模型推理产业链。”张云泉建议,“为大模型企业和愿意通过大模型手段智能化转型的传统企业提供必要的支持和配套服务,快速形成新质智能生产力,助力国产大模型平台企业生态建设和占领市场。”

文章来源:《人民政协报》(2024年11月20日 第 9 版)

(二)COPU名誉主席陆首群《再谈算力竞争》

陆首群 2024.11.25

(补充2024.11.30)

一、建设算力中心

在人工智能时代,依靠算力中心的创新计算能力,对推动人工智能加速发展是必不可少的。算力中心的规模效应很重要,国内小算力的千卡、万卡可能会淘汰,美国正在从十万卡起步,当然大规模算力中心的建设也跟巨额投资、巨大能耗的制约因素有关。

早年Open AI曾设想,在开发GPT-5之后计划建设 Sara集成预训练服务中心,集成7000多张H100算力卡,总算力约7×10⁶TFLOPS,需要电力400MW。

微软参股的Open AI与英伟达曾设想,在开发GPT-6之后计划建设“星际之门”集成预训练服务中心,集成度提高到10万张H100算力卡,总算力约10⁸TFLOPS,需要电力5000MW。

2024年8月,埃隆·马斯克( Elon Musk)宣布建成10万张H100算力卡的机房,成为标配,总算力约为1~2.25*10⁸TFLOPS。

2024年10月,英伟达CEO黄仁勋宣布,将利用星链卫生建设空中大型数据服务中心(10万张卡,可能采用B200芯片集成,总算力约为2.25×10⁸TFLOPS,并声称在2024年底将发射第一颗星链卫星,该算力中心将提为供数据生成和大模型后训练服务。

Meta 将建设集成35万张卡HB200算力卡的算力服务中心,总算力为7×10⁸TFLOPS。

二、英伟达的产品系列(列出FP16单张芯片算力)

算力是人工智能发展的核心动力。算力存在于单张产品的芯片中,智算中心以集成单张卡的算力为人工智能的后训练服务。

英伟达(NVIDIA)从一个制作图形服务器、营业额约6000亿美元的中等企业一跃而成为市值飙升为3.5亿美元全球最大的芯片公司,在全球500强企业中先后超越苹果、微软,成为全球市值第一,称霸GPU算力领域。

英伟达在售或即将发售的GPU产品系列为:

A100,H100,H200,GH200,B100,B200, Full B200,GB200.

其中, Ampere:A100(3.12×10²TF) 为早期产品,H100(10³TF)为目前的旗舰产品, Hopper:H200(10³TF),黄仁勋讲为当前一代仍受欢迎的旗舰产品,超级芯片系统Blackwell:B200(2.25×10³TF) 、Full B200(2.5×10³TF), 今年即将出货的旗舰产品,英伟达还有在售的旗舰产品有:GH200(10³TF),B100(1.75×10³TF)。

英伟达正在走深度学习GPU通用算力发展之路。

三、据IDC报道,2023年国内AI芯片市场销售量

英伟达占90%(462,618),华为占8%(59,156),其他占2%(11,625),

在其他企业中: Badu(9,197), Cambricon(5,977), Kuaishou(1,222), Ilavator (167), Enflame(165), Sophon(128), Denglin(86), H3C(63)

四、2024年国内算力市场的新情况

1)美国政府加强对华打压,不准算力芯片向中国出售,目前英伟达连打折的算力芯片也向中国实行断供。

2)华为自主开发7nm的昇腾910C,其算力对标英伟达H200(103TF,成本要低得多)。比原来生产的910b(对标英伟达A100:3.12×102TF),算力提高3倍多。

3)美国有人怀疑华为 7nm芯片性能落后于美国10年,在美国就引起了争论。从实测数据来看,华为7nm芯片性能完全达到要求,所谓落后10年为不实之辞。

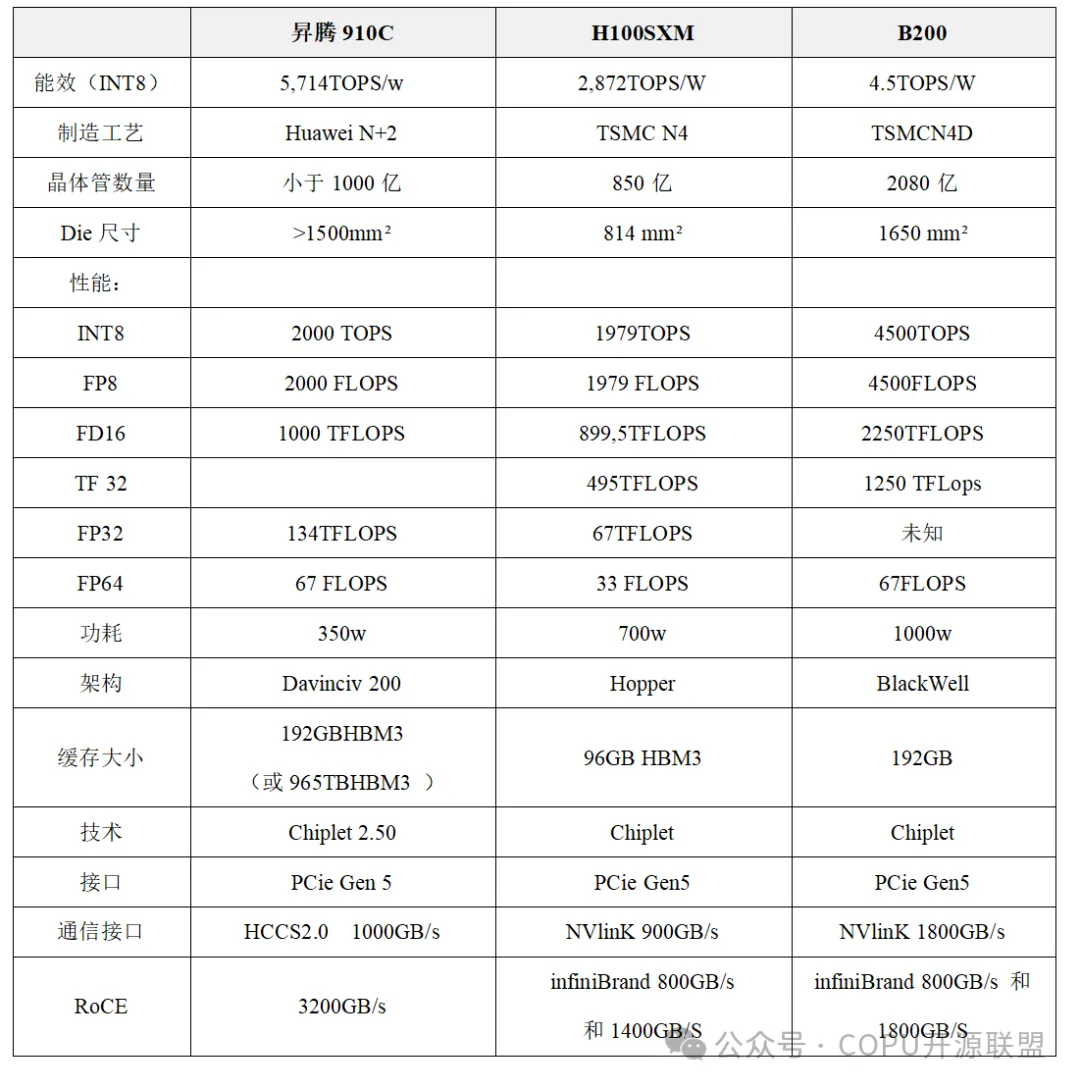

现将华为昇腾910c芯片性能与英伟达GPU比较如下:

4)11月25日中国商务部会见英伟达,商务部副部长王受文在京会见英伟达公司全球副总裁普瑞,考虑到英伟达在人工智能以及芯片领域拥有一定的话语权,寻求进一步发展提升算力,而中国拥有全球最大的消费市场,双方就合作进行讨论。

5)目前美国的头部企业:特斯拉、微软、 Meta、谷歌、亚马逊、英伟达、OpenAI 都在狂砸数百亿美元建设超越10万大卡新的算力中心,他们走的都是深度学习GPU智算之路。科学家最近研究发现,GPU并不是 Transformer的最优算力芯片,语言处理器(LPU)的问世,其推理性能是英伟达GPU的10倍, Etched 公司发布首款ASIC AI芯片: Sohu其性能是英伟达B200 的10倍。目前全球都以深度学习GPU智算作为主流走向的情况下,李国杰院士提出的超算和智算正在实现历史性汇合的意见值得研究。

6)英伟达算力卡芯片离不开中国的镝(材料供应),用作为芯片中几百个小电容抗热。

7)马斯克、黄仁勋认为建设大型算力中心需要巨额投资,几千亿美元~几万亿美元,以至需要几百万亿美元,一般企业(包括头部企业)很难承担;而且能耗巨大,一般10万张卡集成的算力中心年用电量达5000kw(10万张卡以上的集成算力中心用电量更大),马斯克认为世界上只有中国才能承担,美国尚需国外电力支持(他建议可与加拿大合作)。

五、国内发展通用算力之路

有人提出中国超级计算机可提供算力,目前全国超算中心14座(226台),可提供总算力230EFLOPS=2.3×10⁶TFLOPS,可作为自主、自控的国内算力发展之路。

不久前华为轮值董事长孟晚舟有一个讲话,她说算力是人工智能发展的核心动力,华为将成为中国算力之王。她提出华为要走的通用算力发展之路是:不断提高单张芯片卡的算力,建设GPU集成算力中心。

我们来做个比较,超级计算机群提供的算力与GPU集成算力中心比,前者出算效率低(全国超算中心总算力为230EFLOPS=2.3×10⁶TFLOPS,仅为10万张卡GPU集成算力中心算力2.25×10⁸TFLOPS的1/100),而且前者算力分散、后者算力集中。

国内通用算力发展之路还是以华为提出的走建设GPU集成算力中心为好。

本次会议听取京东方王博关于OLED显示屏创新汇报。

今年1月京东方参加在美国拉斯维加斯举办的消费电子产品展览会(CES2024),发布业内首个双滑卷OLED显示屏,具有独特的可滑卷曲特性,可用于手机、车载、笔记本电脑等应用领域,京东方在柔性技术上具备材料,仿真,背板技术开发能力,推出的双滑卷显示技术在会上获得技术创新奖,引发了震恸!

孟伟以LF AI&Data 董事会主席名义汇报了关于开放智算产业联盟的进展与规划。

参会人员:陆首群、孟伟、陈伟、王博、陈道清、陈道新、宋可为、刘楠、张侃、安泱、鞠东颖、刘澎(线上)、陈钟(线上)、韩宪平(线上)、胡宇(线上)、孟迎霞(线上)、Anna.AI(线上)。

作 者丨陆首群 责 编丨鞠东颖

摄 影丨刘 夏